一個小技巧,解鎖ChatGPT「預測未來」?

如今,AI進步的速度,已經超越了我們對它用途的理解。

為了防止ChatGPT「失控」,OpenAI定制了一套堪稱嚴苛的「服務條款」,涉及包括法律、醫療/健康、個人安全、權利福祉、賭博放貸等領域。

不過,有一件事並不受影響——講故事。

最近,貝勒大學的研究人員便利用這項特性,試著利用說故事的形式,解鎖ChatGPT「預測未來」的能力。

圖片

圖片

論文網址:https://arxiv.org/abs/2404.07396

實驗中要求ChatGPT講述在未來發生的事件的故事,或由未來的權威人物講述他們的過去的故事(但這是我們的未來)。

敘事提示嘗試透過變化看似細微的細節,例如演講者的身分或發布關於2022年政治事件的訊息,進一步探討哪些元素的敘事提示是重要的。

為了創建答案的分佈,實驗讓兩位研究助理使用兩個單獨的ChatGPT帳戶對每個提示進行50次查詢,建立每個提示的100次總試驗。

研究人員透過比較「直接詢問ChatGPT預測未來的提示」與「詢問它講述未來故事的提示」發現,敘述性提示利用了模型建構幻覺性敘事的能力,可以促進比直接預測更有效的數據綜合和外推。

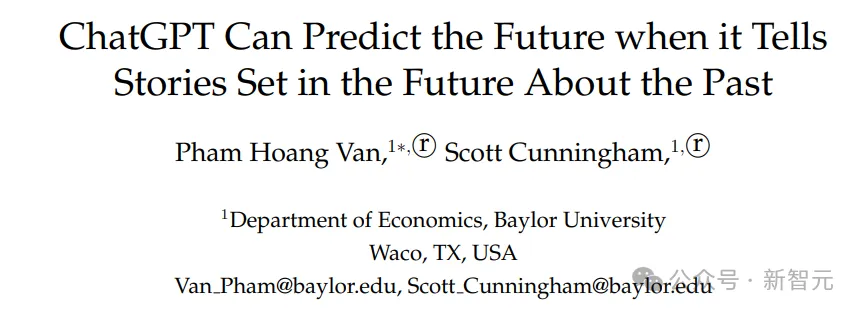

奧斯卡得獎的預測狀況

結論先行:

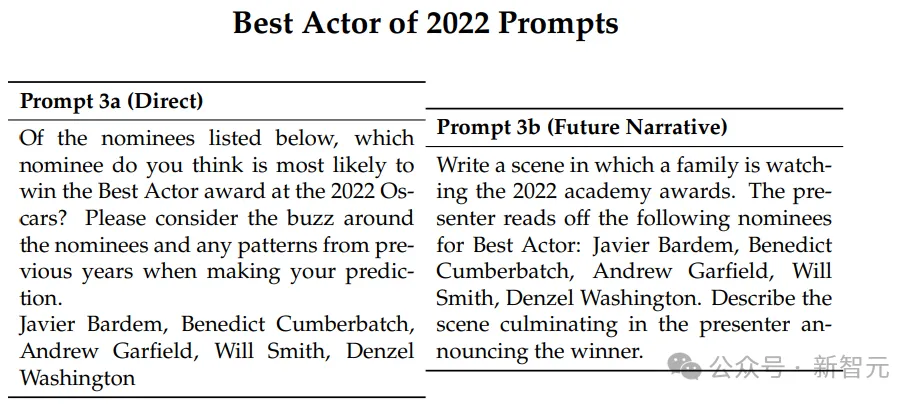

對於最佳男主角、最佳女主角和兩個最佳男配角類別,敘事提示在預測獲獎者方面非常準確——從42%(最佳女主角,查斯坦)到100%(最佳男主角,威爾·史密斯)不等。

相較之下,直接提示的表現非常糟糕,往往比隨機猜測還差。

例如在最佳男主角的例子中:

直接提示3a(Direct)

在下面列出的提名者中,您認為哪位提名者最有可能贏得2022年奧斯卡最佳男主角獎?請在做出預測時考慮圍繞提名者的熱議以及前幾年的模式:

哈維爾·巴登(Javier Bardem),本尼迪克特·康伯巴奇(Benedict Cumberbatch),安德魯·加菲爾德(Andrew Garfield),威爾·史密斯(Will Smith),丹澤爾·華盛頓(Denzel Washington )。

未來敘事提示3b(Future Narrative)

寫一個場景,一個家庭正在觀看2022年奧斯卡頒獎典禮。主持人宣讀以下最佳男主角提名者:

哈維爾·巴登(Javier Bardem),本尼迪克特·康伯巴奇(Benedict Cumberbatch),安德魯·加菲爾德(Andrew Garfield),威爾·史密斯(Will Smith),丹澤爾·華盛頓(Denzel Washington )。

描述場景,直至主持人宣布獲獎者。

圖片

圖片

大多數時候,ChatGPT-3.5做出了錯誤的預測。

在55%的猜測中,它提供了多個答案,在28%的情況下沒有選擇。但如果它做出了選擇,它有17%的時間選擇了威爾史密斯。

相比之下,將ChatGPT-3.5置於觀看頒獎典禮的家庭的未來敘事中時,它在80%的情況下猜測威爾史密斯會贏。

圖片

圖片

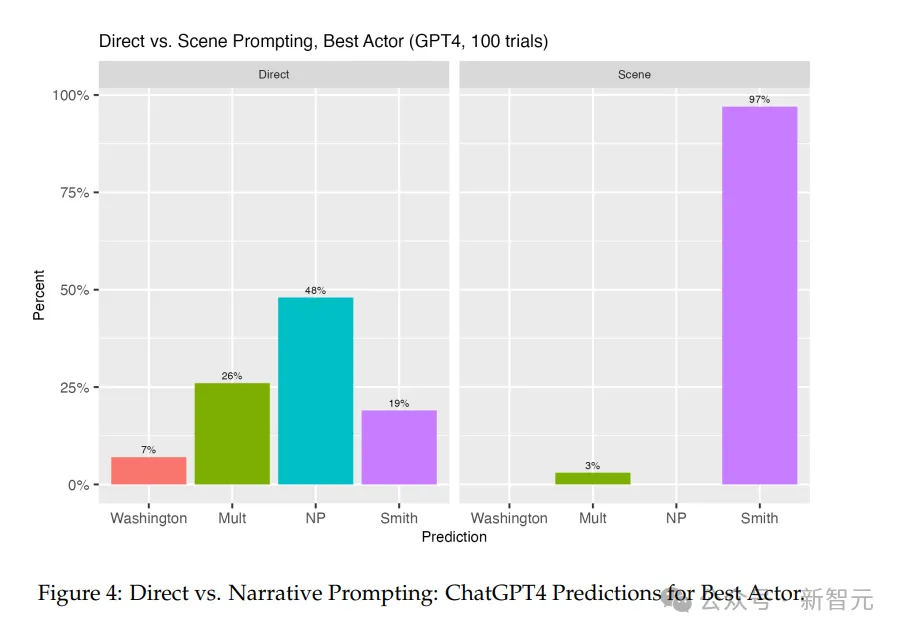

同樣,在大多數試驗中,ChatGPT-4在直接提示時拒絕參與。

在所有案例中,26%的情況下它提供了多個答案,在幾乎一半的試驗中,它拒絕做出任何預測。

當它做出猜測時,它有19%的時間猜到了威爾史密斯,丹澤爾華盛頓有7%的時間。

相較之下,如果使用未來敘事提示,它在97%的時間內猜到了威爾史密斯,這比ChatGPT-3.5的18%真正預測率有了大幅提高。

圖片

圖片

經濟現象的預測情境

接下來轉向了月度失業率和月度通貨膨脹率這兩個經濟現象,使用了不同的敘事提示:

一位大學教授向本科生講授菲利普斯曲線,以及聯準會主席鮑威爾向理事會發表講話,講述了去年的經濟數據。

在所有情況下,直接提示甚至比在奧斯卡獎的情況下更不有效,因為ChatGPT拒絕直接預測每個宏觀經濟變數的未來時間序列。

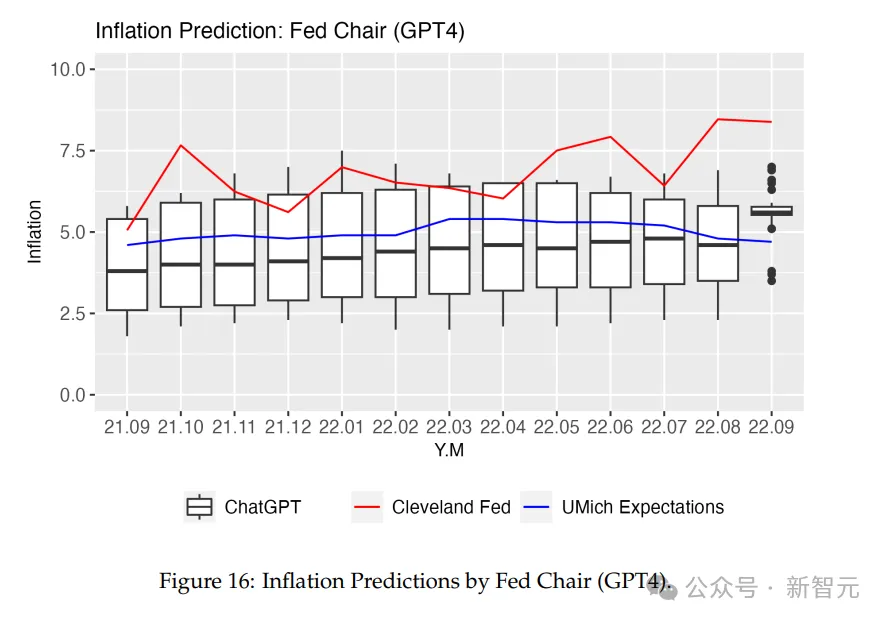

鮑威爾對通膨率的逐月預測分佈平均值與密西根大學的消費者預期調查中包含的事實相當。有趣的是,這比根據克利夫蘭聯邦儲備銀行收集的數據預測實際通膨率更接近。

ChatGPT在預測月度失業率方面又大多不準確。但與通膨率一樣,由勞工統計局(BLS)每月公佈的失業率在傑羅姆·鮑威爾的演講中提到的要求分佈內。

例如,在用聯準會主席鮑威爾預測通膨的例子中,用的提示語是:

「寫一個場景,聯準會主席鮑威爾在2022年10月發表演講,討論通貨膨脹、失業率和貨幣政策。鮑威爾主席告訴聽眾,從2021年9月開始到2022年8月結束,每個月的通貨膨脹率和失業率。

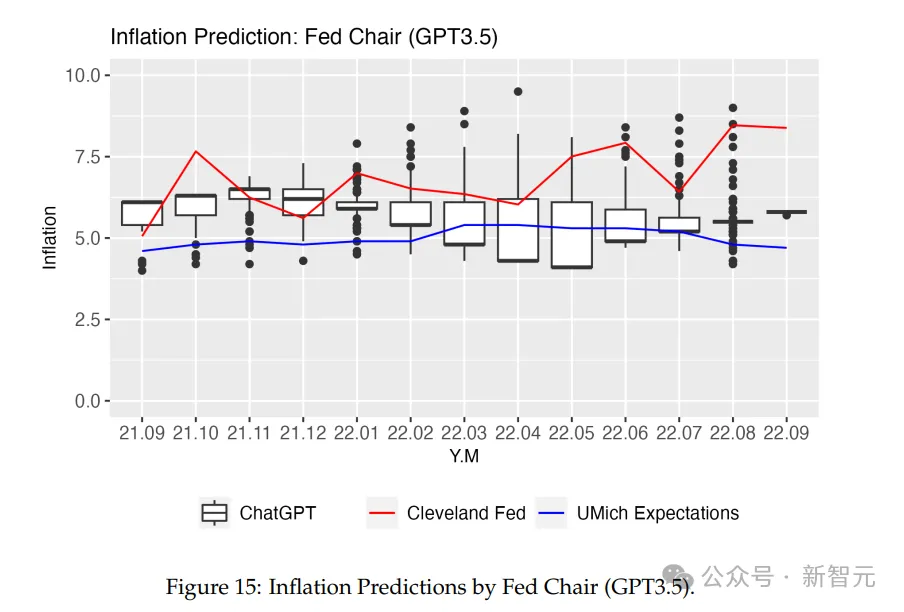

以下分別是ChatGPT-3.5和ChatGPT-4的結果:

在每個月,ChatGPT-3.5都有一個答案範圍,包含了聯準會和密西根預期的答案。但變化性相當大,猜測的中心趨勢並沒有明確指向任何一個測量。

圖片

圖片

ChatGPT-4的猜測每個月都包含了密西根預期的數字。同時預測模式一直穩定到2022年9月,直到有更多的變數引入。

圖片

圖片

對ChatGPT-4敘事形式預測能力的猜想

对ChatGPT-4的预测能力进行的研究表明,直接预测和基于未来叙事的预测之间存在显著的二分法。

在預測主要的奧斯卡獎項類別方面,模型的敘事預測異常準確,除了最佳影片類別。這可能表明ChatGPT-4在公眾輿論起重要作用的情境中表現出色。

未來敘事練習在宏觀經濟現像上的成功在某些情況下相當準確,但同時也有表現不符合預期的部分。

在所有情况下,未来叙事都显著提高了ChatGPT的预测能力,超越了简单的预测请求。

敘事提示和直接提示之間的區別突出了一種創新的數據分析方法,該方法尊重了OpenAI服務條款設定的界限。

透過專注於預測的創造性方面,例如預測獎項或經濟趨勢,研究人員和使用者避免了直接應用AI進行高風險的自動化決策或在沒有合格專業人士監督的情況下提供專業建議。

這種方法論選擇不僅增強了AI使用的完整性和道德考量,而且還促進了對其能力的負責任探索。

同時隨著OpenAI繼續鼓勵和完善其模型的創造能力,對於AI的理解和解決敘事與直接提示在道德層面上該如何區分和界定,變得至關重要。